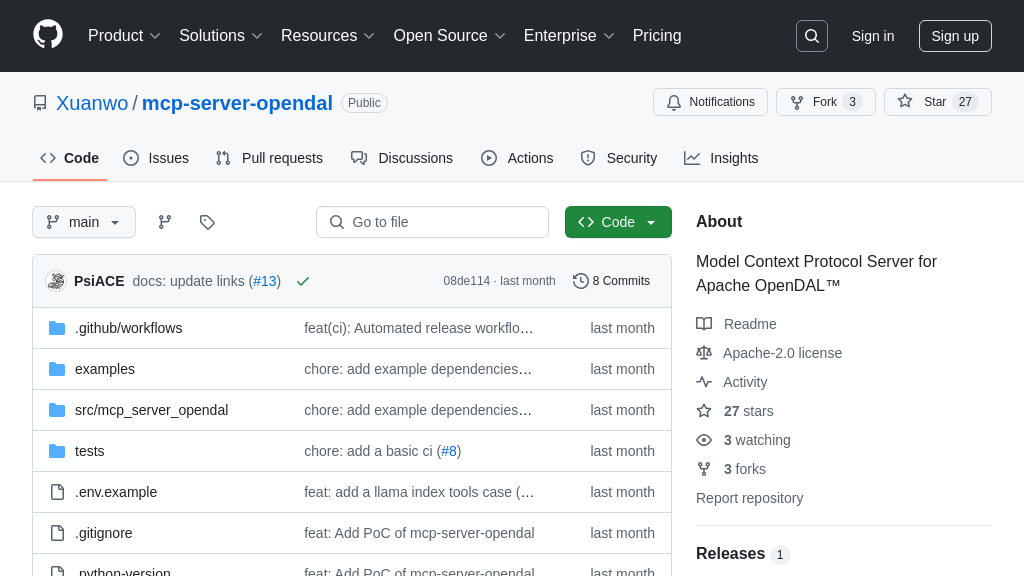

mcp-server-opendal 解决方案概述

mcp-server-opendal 是一款 MCP 服务器,它通过 Apache OpenDAL™ 为 AI 模型提供对多种存储服务的安全便捷访问。它允许 AI 模型无缝访问包括 S3、Azure Blob Storage 和 Google Cloud Storage 在内的多种存储服务,极大地扩展了 AI 应用的数据访问能力。开发者可以通过简单的环境变量配置,轻松连接和管理不同的存储后端。

该服务器的核心功能包括列出存储服务中的文件和目录,以及读取文件内容(自动检测文本/二进制格式)。通过 MCP 协议,AI 模型可以使用 read 和 list 等工具,像访问本地文件一样访问存储在 OpenDAL™ 支持的存储服务中的数据。mcp-server-opendal 基于 Python 实现,并利用 Apache OpenDAL™ 作为底层存储访问库,简化了与各种云存储服务的集成,显著降低了 AI 应用开发中数据访问的复杂性。

mcp-server-opendal 核心能力

多存储服务统一访问

mcp-server-opendal 的核心价值在于它能够通过 Apache OpenDAL™ 库,为 AI 模型提供对多种云存储服务的统一访问接口。这意味着 AI 模型不再需要针对不同的存储服务编写特定的代码,极大地简化了数据访问的复杂性。开发者只需配置相应的环境变量,即可让 AI 模型通过标准的 MCP 协议访问 S3、Azure Blob Storage、Google Cloud Storage 等多种存储服务。例如,一个需要分析存储在不同云平台的日志文件的 AI 模型,可以通过 mcp-server-opendal 轻松地读取这些文件,而无需关心底层存储服务的差异。这种统一的访问方式不仅提高了开发效率,也降低了维护成本。技术实现上,mcp-server-opendal 利用 OpenDAL™ 提供的抽象层,将各种存储服务的 API 调用转换为统一的操作,从而实现了对上层 AI 模型的透明访问。

文件列表与内容读取

mcp-server-opendal 提供了列出存储服务中的文件和目录,以及读取文件内容的核心功能。AI 模型可以通过 MCP 协议发送 list 命令来获取指定目录下的文件列表,这对于需要批量处理数据的场景非常有用。例如,一个图像识别模型需要处理存储在云存储中的大量图片,它可以先通过 list 命令获取所有图片的文件名,然后逐个读取文件内容进行处理。读取文件内容时,mcp-server-opendal 能够自动检测文本或二进制格式,并以适当的方式返回数据,简化了 AI 模型的数据预处理流程。技术实现上,mcp-server-opendal 依赖 OpenDAL™ 提供的文件系统操作接口,实现了高效的文件列表和读取功能。

环境变量驱动配置

mcp-server-opendal 采用基于环境变量的配置方式,使得存储服务的连接信息管理更加灵活和安全。开发者可以通过设置环境变量来配置存储服务的类型、Bucket 名称、区域、Endpoint、访问密钥等信息,而无需将这些敏感信息硬编码到代码中。这种配置方式不仅方便了不同环境下的部署,也提高了安全性。例如,在开发、测试和生产环境中,可以使用不同的环境变量来连接不同的存储服务实例,而无需修改任何代码。mcp-server-opendal 还会从 .env 文件加载配置,进一步简化了本地开发和测试流程。技术实现上,mcp-server-opendal 在启动时会读取环境变量,并根据这些变量初始化 OpenDAL™ 的存储服务客户端。

集成优势

mcp-server-opendal 通过 MCP 协议与 AI 模型无缝集成,为 AI 模型提供安全便捷的数据访问能力。AI 模型可以使用 read 和 list 等 MCP 工具访问存储在 OpenDAL™ 支持的存储服务中的数据,无需关心底层存储服务的具体实现细节。这种集成方式降低了 AI 模型与外部数据源的耦合度,提高了 AI 应用的可维护性和可扩展性。例如,一个自然语言处理模型需要从云存储中读取大量的文本数据进行训练,它可以直接通过 MCP 协议与 mcp-server-opendal 交互,获取所需的数据,而无需编写任何与存储服务相关的代码。这种集成优势使得 AI 模型的开发更加专注于算法本身,提高了开发效率。