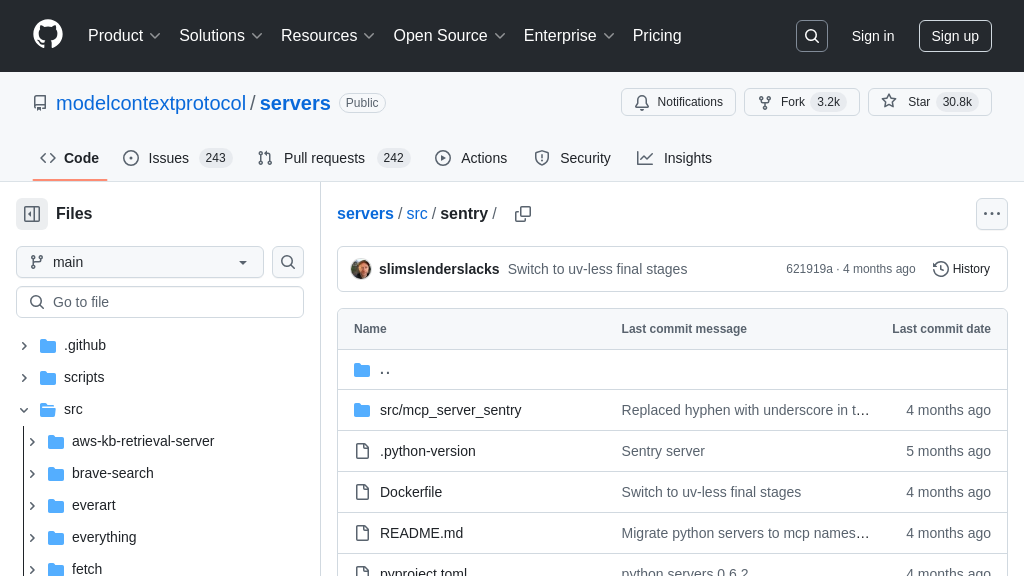

server-sentry 解决方案概述

server-sentry 是一款 MCP 服务器,专为从 Sentry.io 检索和分析问题而设计。它提供强大的工具,用于检查错误报告、堆栈跟踪以及来自 Sentry 账户的其他调试信息。通过 get_sentry_issue 工具,开发者可以根据 issue ID 或 URL 检索 Sentry issue 的详细信息,包括标题、状态、等级、首次出现和最后出现的时间戳、事件计数以及完整的堆栈跟踪。

此服务器与 AI 模型无缝交互,将格式化的 issue 详情作为对话上下文提供,从而帮助 AI 理解和诊断软件问题。server-sentry 解决了开发者在调试和问题追踪方面的痛点,简化了从 Sentry 获取关键信息的流程,并将其集成到 AI 驱动的工作流程中。它可以通过 uv 或 pip 进行安装,并轻松集成到 Claude Desktop 等环境中。使用 server-sentry,开发者可以更高效地利用 Sentry 的数据,加速问题解决和软件质量提升。

server-sentry 核心能力

Sentry问题检索与分析

server-sentry的核心功能是根据Issue ID或URL从Sentry.io检索并分析问题。它允许AI模型访问Sentry中存储的错误报告、堆栈跟踪和其他调试信息。该功能的工作原理是接收一个Issue ID或URL作为输入,然后向Sentry API发起请求,获取该Issue的详细信息。这些信息包括Issue标题、ID、状态、级别(例如,错误、警告)、首次出现时间、最后出现时间、事件计数以及完整的堆栈跟踪。获取到的信息会被格式化并返回给AI模型,使其能够理解问题的上下文并采取相应的行动。

例如,一个AI驱动的调试助手可以使用此功能来自动分析应用程序中的错误。当应用程序抛出一个异常时,AI助手可以调用server-sentry来获取相关的Sentry Issue信息,然后分析堆栈跟踪以确定错误的根本原因,并向开发人员提供修复建议。

格式化问题详情为上下文

server-sentry可以将从Sentry检索到的问题详情格式化为对话上下文,方便AI模型理解和使用。该功能通过将原始的Sentry Issue数据转换成结构化的文本或JSON格式来实现,使其更易于被AI模型解析。格式化后的数据可以包含Issue的摘要、关键属性(如错误类型、发生频率)以及相关的堆栈跟踪片段。

例如,在一个AI驱动的客户支持场景中,当用户报告一个问题时,AI客服可以调用server-sentry获取相关的Sentry Issue信息,并将其格式化为对话上下文。然后,AI客服可以利用这些信息来更好地理解用户的问题,并提供更准确的解决方案。此外,格式化后的数据还可以用于训练AI模型,使其能够更好地识别和解决类似的问题。

标准输入/输出传输支持

server-sentry支持通过标准输入/输出(stdin/stdout)进行数据传输,这使得它可以与各种AI模型和客户端轻松集成。通过标准输入,server-sentry接收来自AI模型的请求,例如Issue ID或URL。然后,它通过标准输出将处理后的结果(例如,格式化的Issue详情)返回给AI模型。这种传输方式的优点是简单、通用,不需要复杂的网络配置或依赖。

例如,一个使用Python编写的AI模型可以使用subprocess模块来调用server-sentry,并通过标准输入/输出与其进行通信。AI模型可以将Issue ID写入server-sentry的标准输入,然后从其标准输出读取格式化的Issue详情。这种方式使得AI模型可以方便地利用server-sentry的功能,而无需关心其内部实现细节。