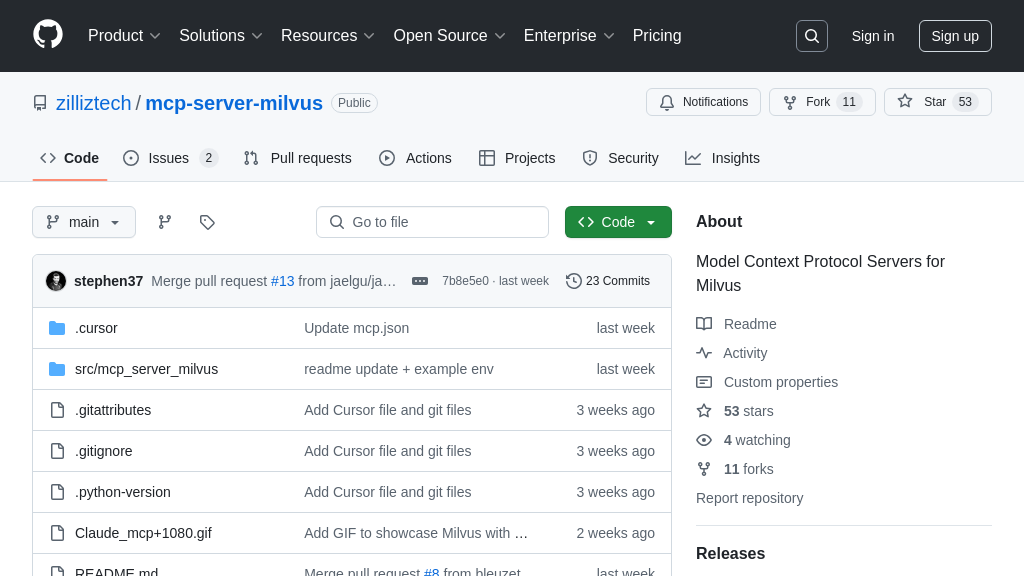

mcp-server-milvus

mcp-server-milvus:为 LLM 应用提供 Milvus 向量数据库连接的 MCP 服务器,赋能 AI 应用强大的向量搜索能力。

mcp-server-milvus 解决方案概述

mcp-server-milvus 是一个 MCP 服务器,旨在为大型语言模型(LLM)应用提供对 Milvus 向量数据库功能的无缝访问。它通过标准化的 MCP 协议,使得 AI 模型能够安全地与 Milvus 交互,从而增强了 LLM 在处理向量搜索、数据查询和集合管理等任务上的能力。

该服务器提供了一系列工具,包括向量相似性搜索、全文检索、数据插入和删除等,极大地简化了开发者在 AI 应用中集成向量数据库的流程。开发者可以通过简单的配置,将 mcp-server-milvus 集成到支持 MCP 协议的 LLM 应用中,例如 Claude Desktop 和 Cursor。这不仅降低了开发难度,还提升了 AI 应用的智能化水平,使其能够更好地理解和利用外部数据。通过 mcp-server-milvus,开发者可以充分利用 Milvus 的高性能向量检索能力,构建更强大的 AI 应用。

mcp-server-milvus 核心能力

向量相似性搜索

mcp-server-milvus 的核心功能之一是支持向量相似性搜索,它允许AI模型基于向量嵌入在Milvus数据库中查找语义相关的文档或数据。该功能通过 milvus_vector_search 工具实现,它接受集合名称、查询向量、向量字段、结果数量限制、输出字段以及距离度量类型等参数。其工作原理是将AI模型生成的向量嵌入作为查询条件,在Milvus数据库中执行ANN(Approximate Nearest Neighbor)搜索,返回与查询向量最相似的向量对应的文档。

例如,在一个AI驱动的代码编辑器中,用户可以选中一段代码,编辑器将这段代码转换为向量嵌入,然后使用 milvus_vector_search 在代码库中搜索相似的代码片段,帮助开发者快速找到相关的示例或函数定义。这极大地提高了代码编写和理解的效率。该功能依赖于Milvus高效的向量索引和搜索能力,并将其无缝集成到MCP生态系统中,为AI模型提供强大的语义搜索能力。

灵活的数据查询与过滤

mcp-server-milvus 提供了强大的数据查询与过滤功能,允许AI模型根据特定的条件从Milvus数据库中检索数据。该功能通过 milvus_query 工具实现,它接受集合名称、过滤表达式、输出字段和结果数量限制等参数。过滤表达式使用Milvus支持的布尔表达式语法,可以实现复杂的条件查询。其工作原理是将AI模型的查询请求转换为Milvus的查询语句,然后执行查询并返回结果。

例如,在一个AI助手应用中,用户可以提问“查找年龄大于20岁的所有用户”,AI助手可以使用 milvus_query 工具,设置 filter_expr 为 "age > 20",从Milvus数据库中检索满足条件的用户信息。这使得AI模型能够根据用户的具体需求,从海量数据中快速提取所需的信息。该功能为AI模型提供了灵活的数据访问能力,使其能够更好地理解用户意图并提供个性化的服务。

集合管理与动态创建

mcp-server-milvus 允许AI模型动态地管理Milvus中的集合,包括创建、加载和释放集合。milvus_create_collection 工具允许AI模型根据指定的模式创建新的集合,而无需人工干预。这对于需要动态调整数据存储结构的应用场景非常有用。milvus_load_collection 和 milvus_release_collection 工具则允许AI模型控制集合在内存中的加载和释放,从而优化资源利用率。

例如,在一个AI驱动的知识库管理系统中,当新的知识领域出现时,AI模型可以自动创建一个新的集合来存储该领域的数据,并根据访问频率动态地加载和释放集合,从而实现高效的知识管理。这使得AI模型能够适应不断变化的数据需求,并保持良好的性能。该功能为AI模型提供了对Milvus数据库的完全控制权,使其能够更好地管理和利用数据。

技术实现:标准输入/输出通信

mcp-server-milvus 使用标准输入/输出(stdin/stdout)作为主要的通信机制,这使得它可以与各种支持MCP协议的客户端轻松集成。服务器通过标准输入接收来自客户端的请求,并将结果通过标准输出返回给客户端。这种简单的通信方式降低了集成的复杂性,并提高了系统的可移植性。同时,服务器使用Python编写,并依赖于Milvus的Python SDK,这使得开发者可以方便地扩展和定制服务器的功能。