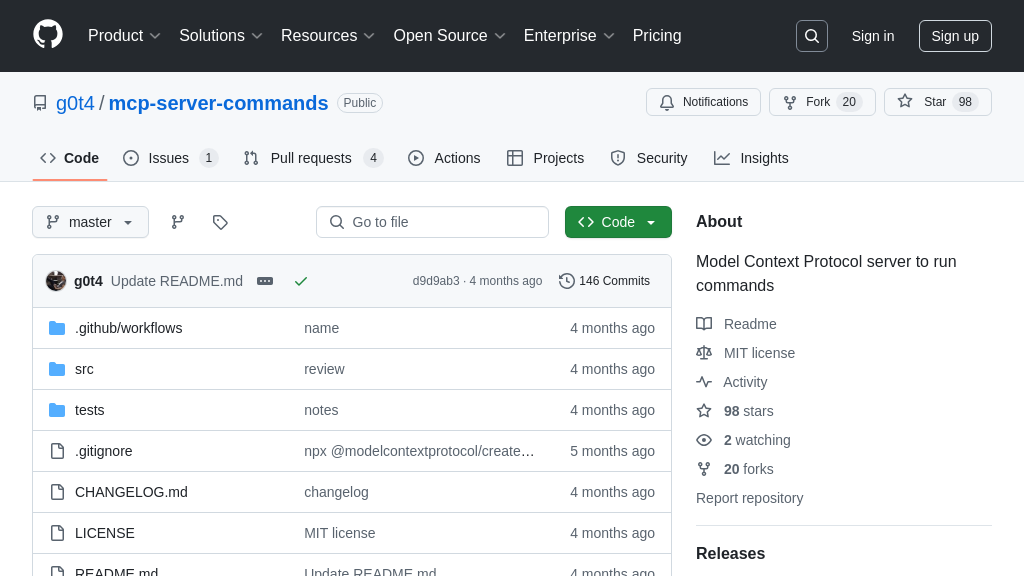

PixVerse-MCP

PixVerse-MCP 是一款官方 MCP 服务器,让您通过 Claude 或 Cursor 等客户端,直接调用 PixVerse 的 AI 视频生成功能,轻松实现文本到视频创作。

PixVerse-MCP 解决方案概述

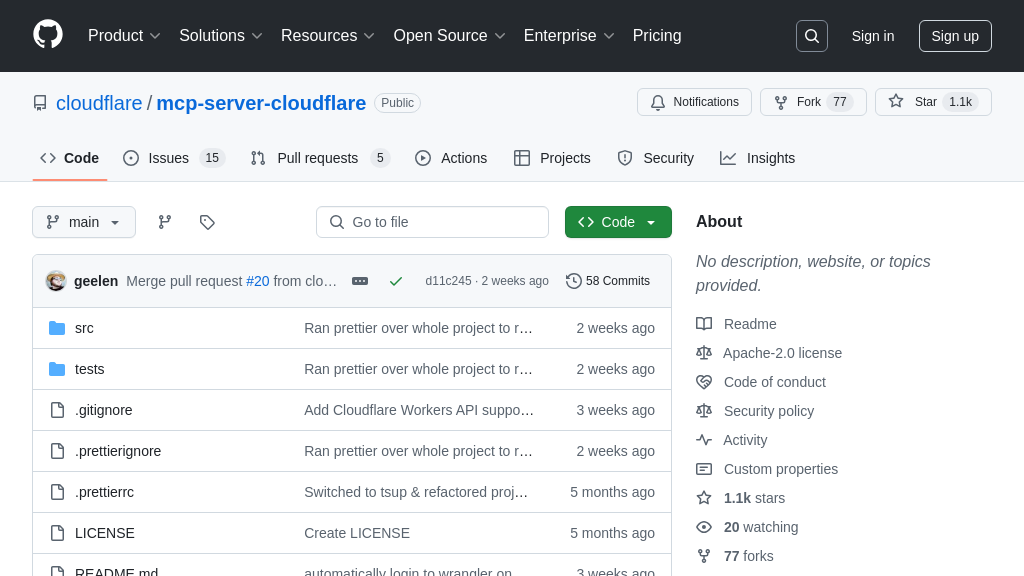

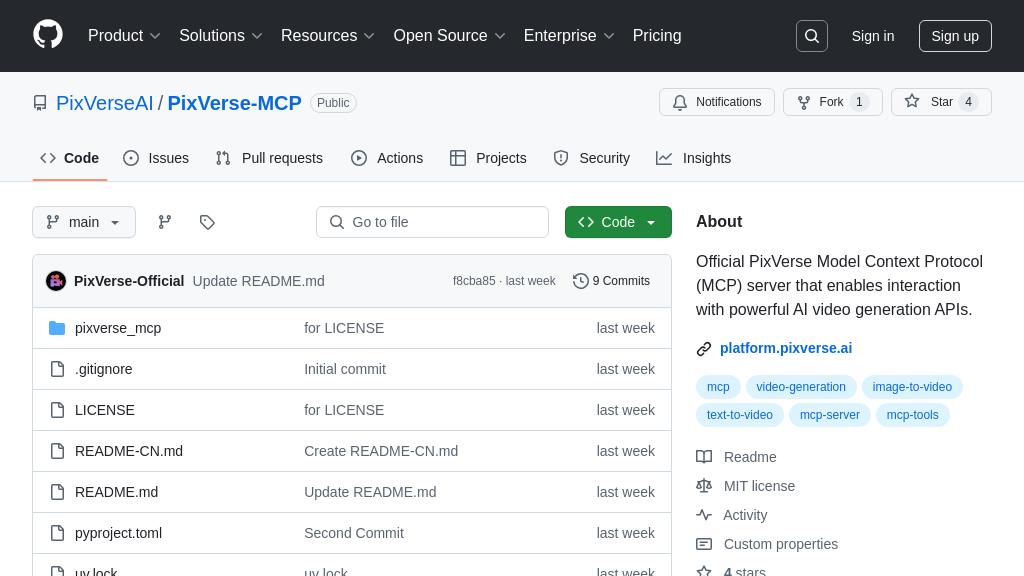

PixVerse-MCP 是一款官方 PixVerse MCP 服务器,使开发者能够通过支持模型上下文协议 (MCP) 的客户端(例如 Claude 或 Cursor)直接调用 PixVerse 最新的 AI 视频生成模型。作为 MCP 生态系统中的一个关键工具,它专注于将文本提示转化为高质量视频,并允许在提示中精细控制宽高比、时长和质量等参数。PixVerse-MCP 充当客户端与 PixVerse API 之间的桥梁,让开发者可以在熟悉的 AI 助手环境中无缝协作,扩展了 AI 模型的能力边界。其核心价值在于通过标准化的 MCP 协议,将先进的视频生成功能便捷地集成到现有开发工作流中,显著提升创作效率。集成方式简单,只需在 MCP 客户端配置中指定运行命令并提供 PixVerse API 密钥即可。

PixVerse-MCP 核心能力

通过MCP实现文本生成视频

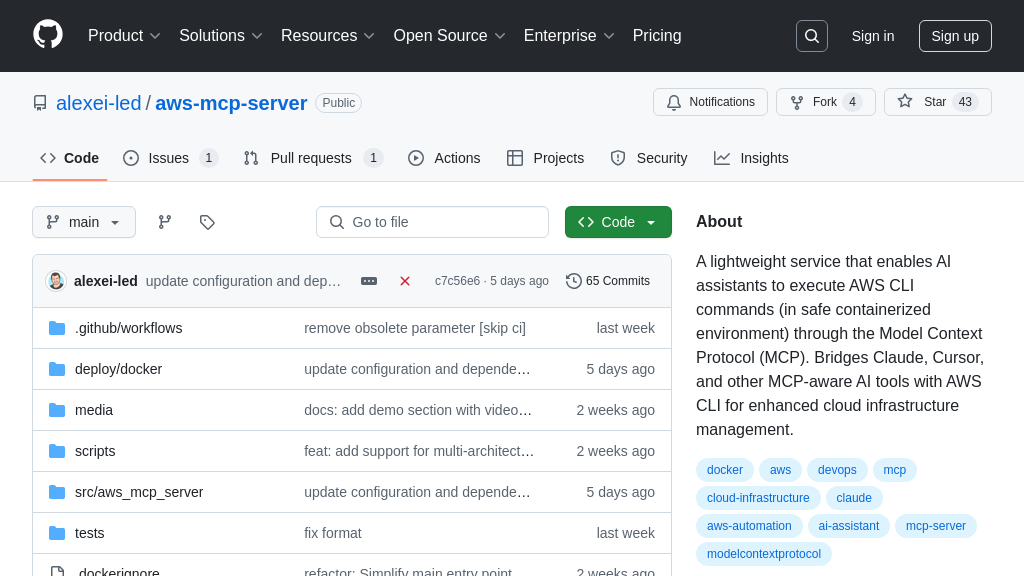

PixVerse-MCP的核心价值在于它充当了一个标准的MCP服务器,将强大的PixVerse视频生成能力无缝集成到支持MCP协议的客户端应用程序(如Claude桌面版或Cursor编辑器)中。用户可以直接在他们熟悉的AI助手界面内,使用自然语言文本提示来创建视频。工作流程如下:用户在MCP客户端中输入描述性的文本提示,例如“生成一段日落海滩的视频,金色阳光洒在水面,海浪轻拍沙滩”。客户端通过MCP协议将此请求发送给本地运行的PixVerse-MCP服务器。该服务器(一个基于Python和UVX构建的组件)接收请求,解析出用户的意图,并使用用户的PixVerse API密钥与PixVerse云端API进行安全通信。服务器将文本提示传递给PixVerse的AI模型进行处理。视频生成完成后,PixVerse API返回一个指向生成视频的URL。PixVerse-MCP服务器再将这个URL通过MCP协议回传给客户端,用户即可在客户端界面内直接查看、下载或分享生成的视频。这种集成方式极大地简化了视频创作流程,让用户无需离开当前工作环境即可利用先进的视频生成技术。

提示词内灵活参数控制

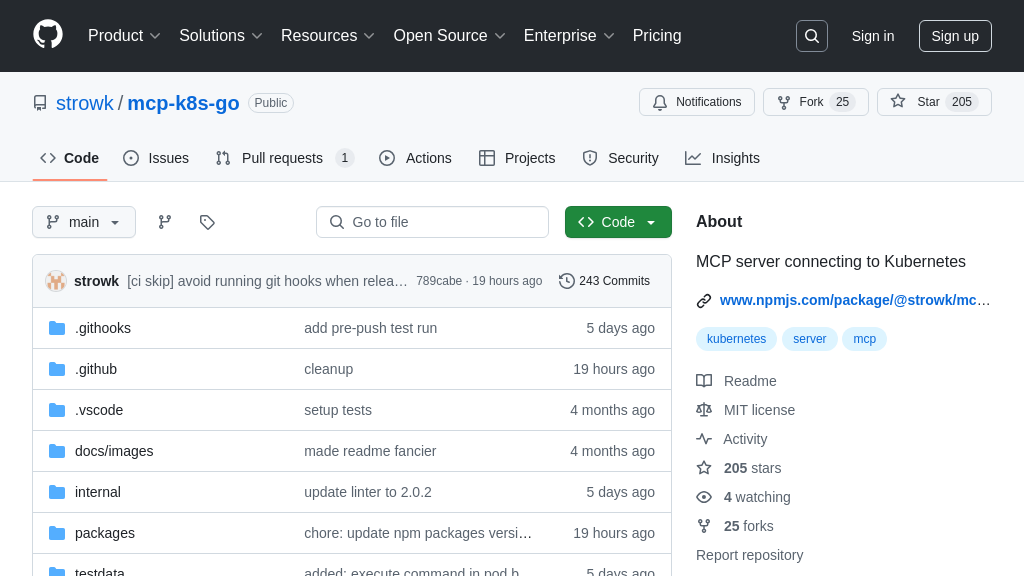

PixVerse-MCP允许用户在提交给MCP客户端的自然语言提示词中直接嵌入详细的视频生成参数,提供了高度的灵活性和控制力。用户无需通过复杂的图形界面或额外的配置步骤,只需在文本描述中添加特定的指令即可调整输出视频的关键属性。支持的参数包括视频宽高比(如Aspect Ratio: 16:9)、时长(Duration: 5s或8s)、清晰度(Quality: 540p,支持从360p到1080p)、运动模式(Motion Mode: normal或fast)以及负面提示(Negative Prompts: blur, shaking,用于排除不希望出现的元素)。例如,一个高级提示可以是:“生成一段夜晚城市景观视频,内容:摩天大楼灯光闪烁,车灯在道路上形成光轨。宽高比:16:9。质量:540p。时长:5秒。运动模式:normal。负面提示:模糊,晃动,文字。” PixVerse-MCP服务器负责解析这些嵌入在提示词中的参数,并将它们与核心内容描述一起准确地传递给PixVerse API。这种设计充分利用了MCP客户端的文本交互特性,使得复杂视频定制变得直观便捷。

与AI助手协同创作视频

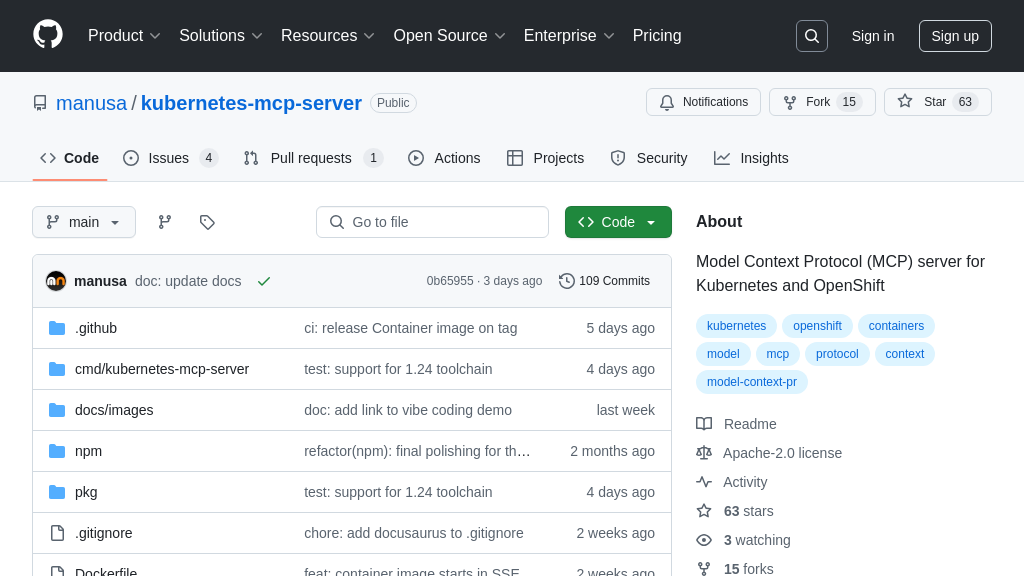

PixVerse-MCP不仅仅是一个简单的API桥梁,它促进了用户与MCP客户端内置AI助手(如Claude)之间的协同创作。用户可以利用AI助手的语言理解、推理和创意能力来构思和优化视频内容,然后再触发PixVerse进行生成。这种协同工作流体现在多个方面:用户可以先与AI助手讨论视频创意,让AI生成详细的场景描述或分镜脚本,然后指示AI使用这些描述配合PixVerse-MCP生成视频。例如,用户可以要求Claude:“根据这个故事板生成视频:- 开头:俯视拍摄一个冒着热气的咖啡杯... 格式:1:1方形,质量:540p,运动:fast。” 如果MCP客户端支持图像输入(如Claude桌面版),用户还可以上传图片,让AI助手分析图片内容,并基于此生成视频概念或风格迁移的提示。例如,用户上传一张街道照片,然后提问:“如果这张街景照片是一部电影的开场,接下来会发生什么?提供一个简短的视频概念。” AI助手会生成相应的文本提示,用户确认后即可通过PixVerse-MCP执行视频生成。这种方式将AI助手的智能与PixVerse的生成能力结合,显著提升了视频创作的效率和创意空间。